EU se shodla na podobě regulace AI jako první na světě. Její možný dopad budí pochyby

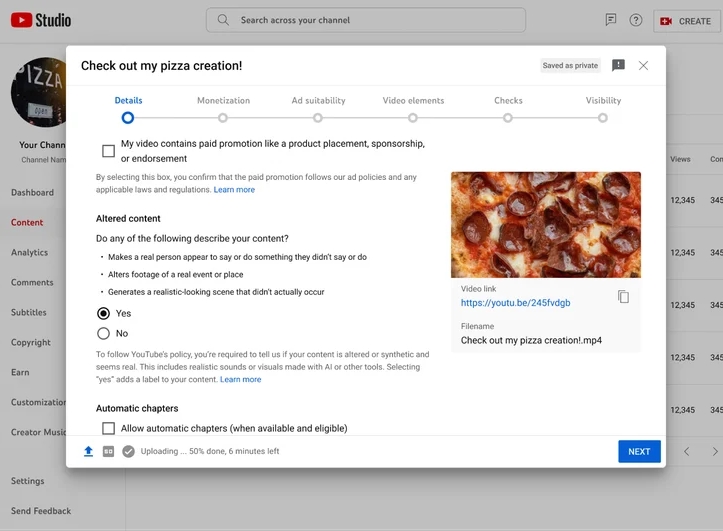

Zdroj: DALL-E 3 dle promtů Maketing Journalu

Dohoda je dosažena. Na podobě Aktu o umělé inteligenci se shodli poslanci Evropského parlamentu, členské země EU zastoupené Radou a odborníci z Evropské komise, a to po 36 hodinách jednání.

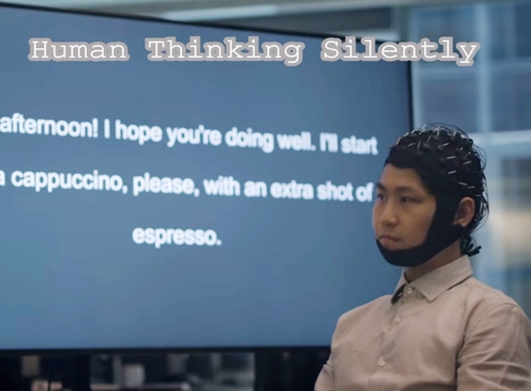

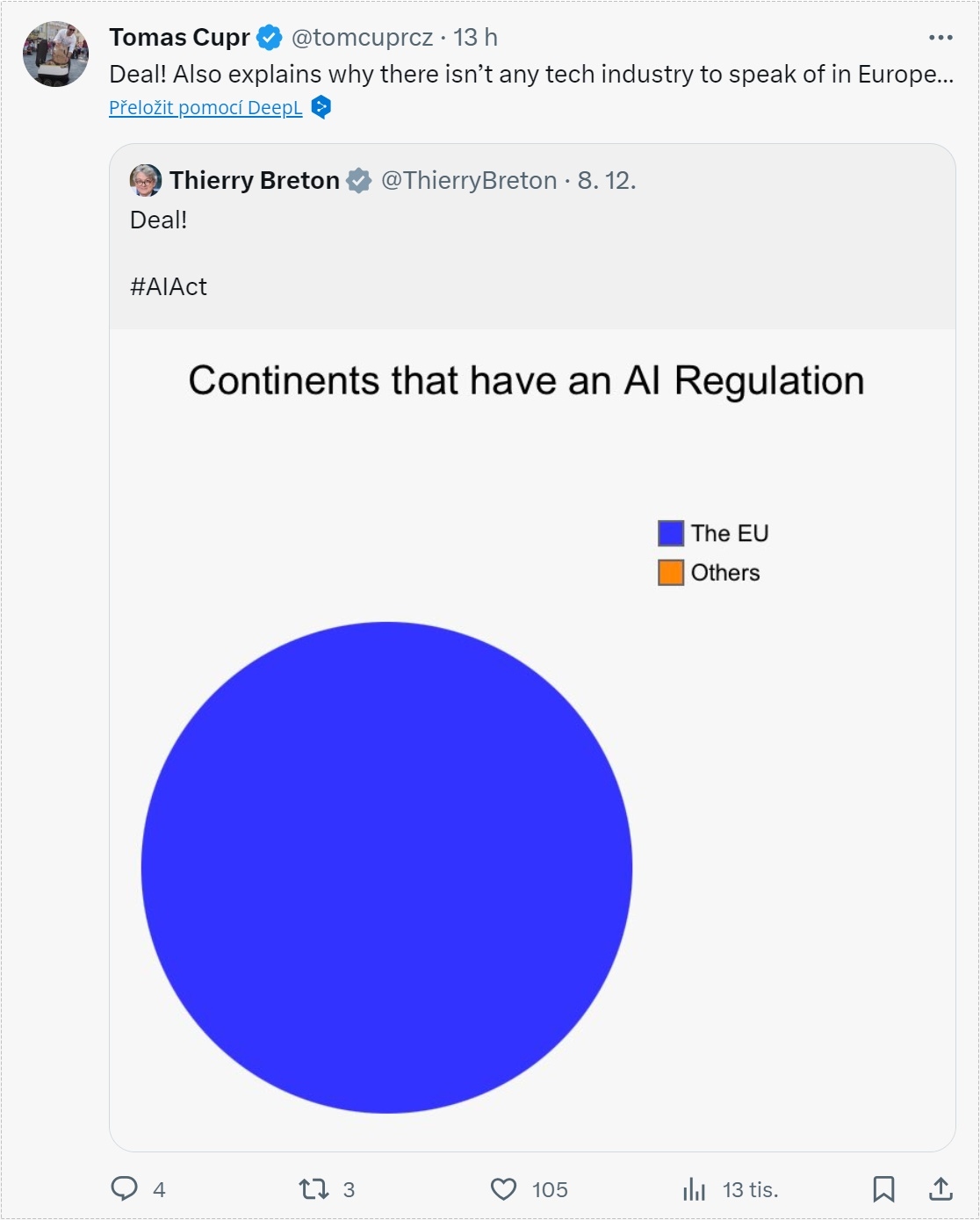

Komisař pro vnitřní trh Thierry Breton uvedl na webu X:

„EU se stává vůbec prvním kontinentem, který stanoví jasná pravidla pro využívání AI. AI Act (Akt o umělé inteligenci) je mnohem víc než jen soubor pravidel — je to startovní rampa pro startupy a výzkumné pracovníky z EU, kteří se stanou lídry globálního závodu v oblasti umělé inteligence."

Regulace by se měla řídit podle toho, jak vysoké vidí zákonodárci riziko v konkrétním využití AI pro společnost.

Mezi řešená témata patří například rozpoznávání obličejů a další formy biometrické identifikace, AI řízení a provoz kritické infrastruktury nebo využívání umělé inteligence při prosazování práva a prediktivní policejní práce. Poslední termín zahrnuje sbírání dat a modelování dat, v praxi by mělo vést k:

- předvídání času a místa, ve kterém je pravděpodobnější výskyt trestných činů;

- policejní činnosti založené na předvídání typu trestných činů, které se mohou pravděpodobně vyskytnout;

- předvídání jednotlivců, kteří se s největší pravděpodobností dopustí trestného činu.

První dva body pro svou nejvyšší efektivitu vyžadují pravděpodobně rozsáhlý kamerový systém v ulicích. Řekněme ale, že s anonymizovanými daty se to zdá i pro velkou část západního světa něčím přijatelným. Když se posuneme k poslednímu bodu na úroveň jednotlivců, můžete se v nejextrémnější interpretaci dostat k naplnění povídky Minority Report od Philipa K. Dicka, ve které jsou za zločince považováni i ti, u nichž systém vyhodnotil, že nějakou ilegální činnost hodlají spáchat.

Někde mezitím může být i sociální kreditový systém, který v různých provinciích v různé míře zavádí Čína. Přímo proti němu se také AI Act vyslovuje.

Hlasy znějící proti příliš tvrdé regulaci AI přitom zdůrazňují, že legislativa by neměla rozvoj umělé inteligence příliš svázat, nebo nám Čína v jejím rozvoji uteče, a to bude ještě větším bezpečnostním rizikem.

„USA měly ve srovnání s EU trochu jiný pohled na to, jak vypadá dobrá správa a regulace technologií… Chceme zajistit, aby vedoucí postavení v oblasti technologií v 21. století pevně převzaly společnosti, vlády, země a koalice, které respektují právo,“ řekl dle Politico Nathaniel Fick, americký velvyslanec pro kyberprostor a digitální politiku na jednáních G7 v Kjótu na začátku listopadu. Tento americký postoj ostatně stvrzuje říjnový zákaz exportu pokročilých mikročipů do Číny, které by mohly být využity pro vojenské účely, ale také pro rozvoj AI technologií.

Věra Jourová lobbuje za shodu na základních principech přístupu k AI na mezinárodní scéně

Nelze proto předpokládat, že by americká úprava legislativy pro AI byla tak přísná jako ta evropská. Přesto se v posledních měsících snažila komisařka pro hodnoty a transparentnost Věra Jourová o to, aby dosáhla nějaké shody i na mezinárodní scéně, zejména mezi ekonomicky nejrozvinutějšími zeměmi na fóru G7 v Kjótu. Dosud byl předložen návrh 11 principů, které si můžete přečíst zde.

Jedná se o principy, které je těžké rozporovat. Od nezávazného souhlasu s deklarací k jejímu vymáhání bývá ovšem daleko, stejně jako ke konkrétní shodě na věcech jako „zavedení vhodných kontrol zadávání dat a jeho auditů“ (jde o 11. princip návrhu, pozn. red.).

Akt o umělé inteligenci je velmi specifický, přesto může jeho vymáhání představovat praktickou i politickou výzvou

Unijní AI Act je mnohem konkrétnější, pokrývá například:

Kognitivní behaviorální manipulace s lidmi nebo specifickými zranitelnými skupinami: například hlasem aktivované hračky, které podporují nebezpečné chování dětí“

Zakazuje biometrické kategorizační systémy založené na citlivých osobních znacích, jako je rasa, politické názory a náboženské přesvědčení, „pokud tyto charakteristiky nemají přímou souvislost s konkrétním trestným činem nebo jeho hrozbou“.

U AI modelů nejvyšší úrovně ukládá mezi povinnosti hodnocení modelu, posuzování a sledování systémových rizik, ochranu kybernetické bezpečnosti a podávání zpráv o spotřebě energie modelu.

AI Act se nicméně nevztahuje na open-source software, pokud se nejedná o vysoce rizikový systém, zakázané aplikace nebo řešení umělé inteligence, u nichž hrozí riziko manipulace.

Tomáš Čupr poukazuje na dle jeho pohledu nevýznamný technologický sektor v Evropě jako důsledek unijní legislativy. Zdroj: X / @tomcuprcz

U každé legislativy je nicméně zásadní možnost její vymahatelnosti. Je zřejmé, že použití ultimátní hrozby ze strany EU v podobě zákazu služby typu ChatGPT v zemích EU by mohlo vést okamžitě ke ztrátě konkurenceschopnosti místních firem v celosvětovém srovnání. Kritici ji ostatně vidí už v tom, že kvůli pověsti EU jako přísného regulátora se mnohé technologické služby dostávají na unijní trh se zpožděním. Ve sféře AI jsme toho svědky i v posledních dnech, kdy nový jazykový model od xAI Elona Muska, Grok, je prvně distribuován Premium+ předplatitelům X v USA, podobně pak nový multimodální AI model Gemini od Googlu bude ve verzi Pro součástí Barda téměř na celém světě, ovšem mimo zemí EU.

Reálný dopad Aktu o umělé inteligenci na držení AI v bezpečných mezích v globálním kontextu je proto v tuto chvíli velmi nejistý.